0013. fish-speech tts 体验

1. 📝 概述

25.06在找 tts 解决方案,了解了一些免费和付费的方案。- 免费方案:

- tts maker

- github 开源项目,比如:

- fish-speech - https://github.com/fishaudio/fish-speech

- TTS - https://github.com/coqui-ai/TTS

- 收费方案:

- 字节的火山引擎 tts 服务

- 阿里的阿里云 tts 服务

2. 💻 免费方案 - fish-speech tts 体验

- fish-speech - https://github.com/fishaudio/fish-speech

- 在本地成功部署了,并体验了

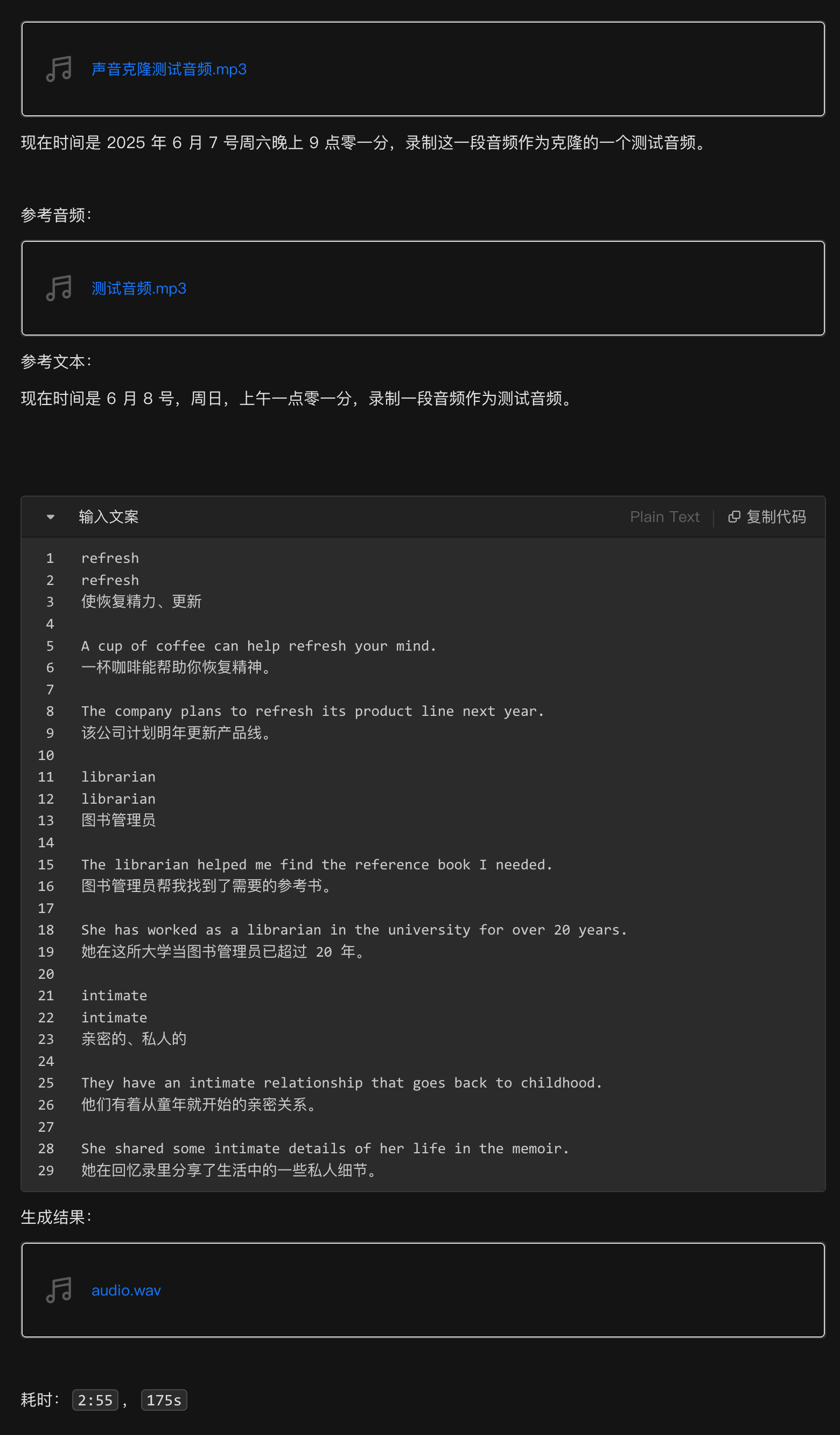

openaudio-s1-mini模型的效果,上传了个人的音频作为克隆样本,就mini模型而言,感觉克隆效果还是蛮不错的。 - 环境准备好之后,以

webui的形式在本地跑openaudio-s1-mini模型。 - 更大的模型就带不动了,尚未体验过。

- 在本地成功部署了,并体验了

- 基本流程:

- 克隆项目到本地

git clone https://github.com/fishaudio/fish-speech.git - 安装依赖

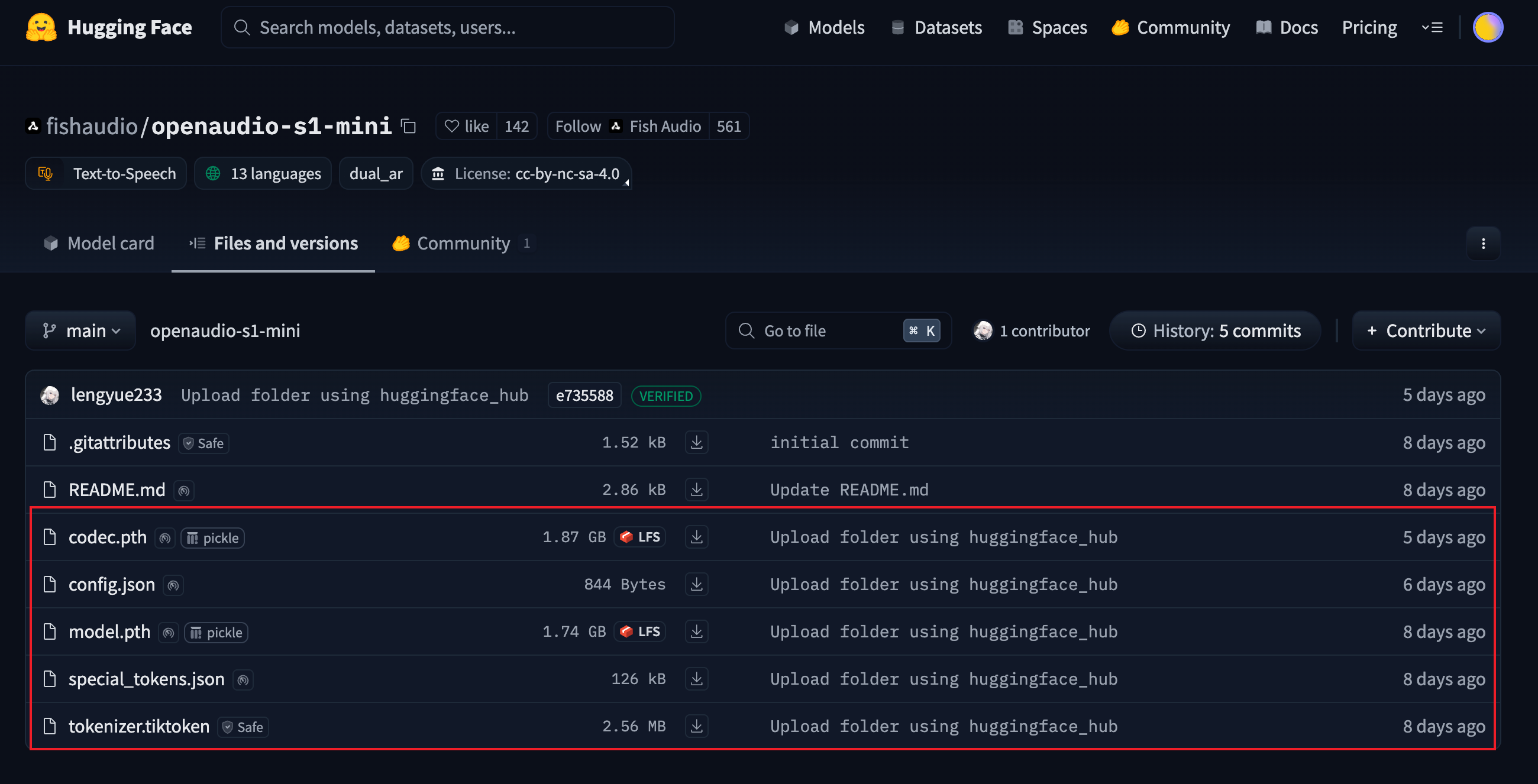

- 上 Hugging Face 下载 mini 模型相关的文件丢到项目根目录下的

checkpoints/openaudio-s1-mini下。 - 启动 webui

python tools/run_webui.py

- 克隆项目到本地

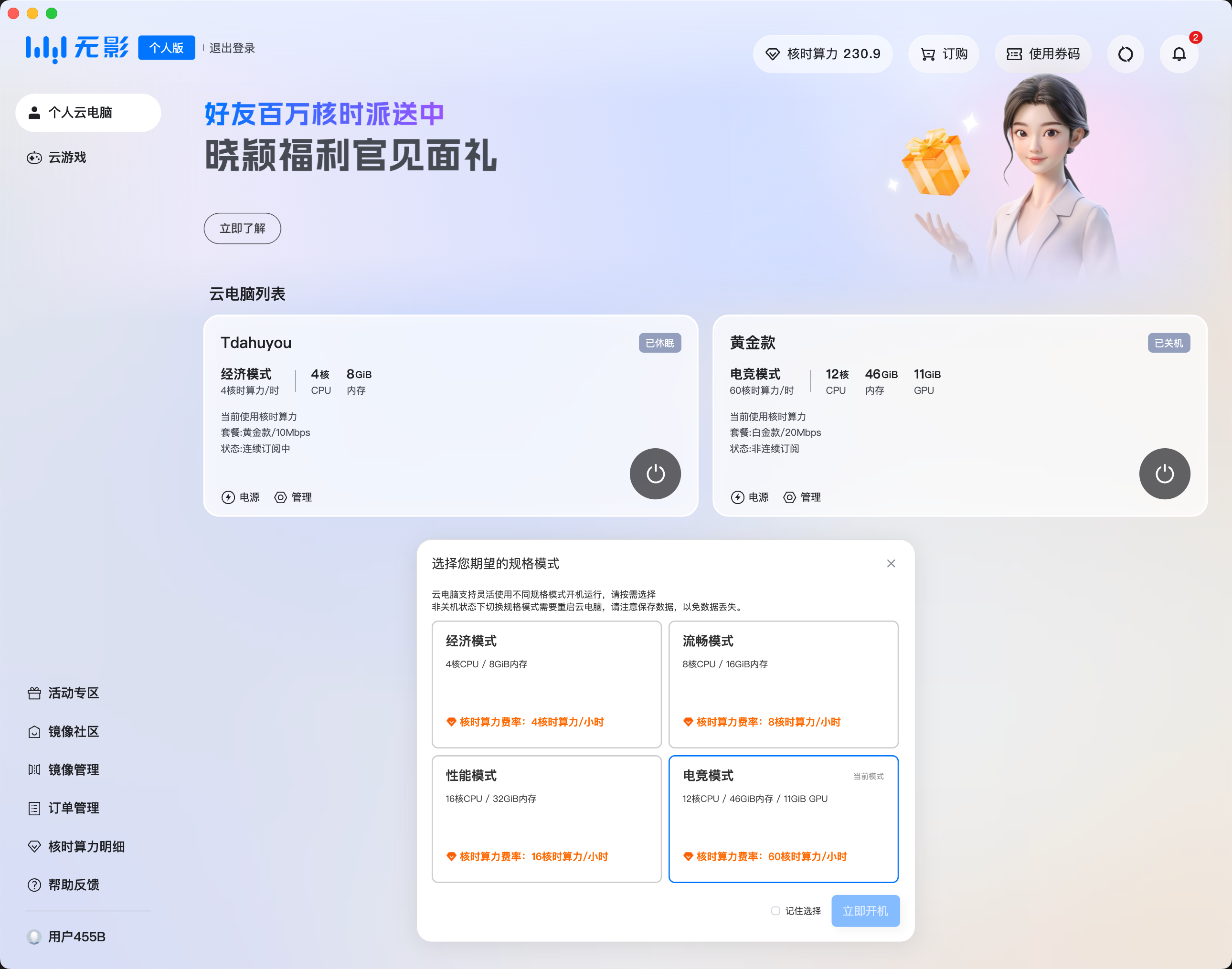

- 环境:

- 环境用的是阿里云主机,显卡是

2080 Ti。

- 这已经是当前能选择的个人云主机最高配了。

- 环境用的是阿里云主机,显卡是

- 速度:

- 转换速度测试下来是 500 字符,3min 左右。

- 如果没有 GPU,用 CPU 去跑的话,更慢 ……

- 在启动 webui 的时候可以通过终端日志看到是否用的是 cpu。

- 这速度确实接受不了,如果要把当前需要转的几十万字符去转为音频,压根儿就等不了。

- 当识别的字符数达到 5k 左右的时候,运行出现了异常。

- 转换速度测试下来是 500 字符,3min 左右。

TNotes.yuque- 输出的一些测试音频啥的记录在了

TNotes.yuque上。 - 如有需要,可以去预览一下当时上传的克隆测试音频,以及使用

mini模型转换文本后得到的识别结果。

- 输出的一些测试音频啥的记录在了

3. 📒 收费方案评价

- 以字节的 tts 服务为例:(因为从听感上来看,感觉豆包的语音更好一些)

- https://www.volcengine.com/product/tts

- 最便宜的 10w 字符需要 36 元,就 en-notes.0012 中要转换的字符就 20w↑ 了,单是 QWERTY Learner 的 CET-4 的识别需求估计就得破百了。

- 果断放弃……

- 其他厂家的收费标准也就没必要去细看了,估计都差不太多,要么就是费用接受不了,要么就是音质接受不了。